文章目录

- 一、实战概述

- 二、提出任务

- 三、完成任务

- (一)准备数据文件

- 1、在虚拟机上创建文本文件

- 2、将文本文件上传到HDFS指定目录

- (二)实现步骤

- 1、启动Hive Metastore服务

- 2、启动Hive客户端

- 3、基于HDFS文件创建外部表

- 4、查询单词表,所有单词成一列

- 5、基于查询结果创建视图

- 6、基于视图进行分组统计

- 7、基于嵌套查询一步搞定

一、实战概述

-

在本次实战中,我们任务是在大数据环境下使用Hive进行词频统计。首先,我们在master虚拟机上创建了一个名为test.txt的文本文件,内容包含一些关键词的句子。接着,我们将该文本文件上传到HDFS的/hivewc/input目录,作为数据源。

-

随后,我们启动了Hive Metastore服务和Hive客户端,为数据处理做准备。在Hive客户端中,我们创建了一个名为t_word的外部表,该表的结构包含一个字符串类型的word字段,并将其位置设置为HDFS中的/hivewc/input目录。这样,Hive就可以直接读取和处理HDFS中的文本数据。

-

为了进行词频统计,我们编写了一条Hive SQL语句。该语句首先使用explode和split函数将每个句子拆分为单个单词,然后通过子查询对这些单词进行计数,并按单词进行分组,最终得到每个单词的出现次数。

-

通过执行这条SQL语句,我们成功地完成了词频统计任务,得到了预期的结果。这个过程展示了Hive在大数据处理中的强大能力,尤其是对于文本数据的分析和处理。同时,我们也注意到了在使用Hive时的一些细节,如子查询需要取别名等,这些经验将对今后的数据处理工作有所帮助。

二、提出任务

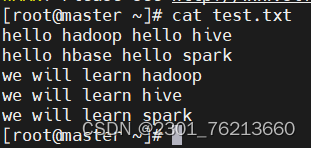

- 文本文件test.txt

hello hadoop hello hive hello hbase hello spark we will learn hadoop we will learn hive we love hadoop spark

- 进行词频统计,结果如下

hadoop 3 hbase 1 hello 4 hive 2 learn 2 love 1 spark 2 we 3 will 2

三、完成任务

(一)准备数据文件

1、在虚拟机上创建文本文件

- 在master虚拟机上创建test.txt文件

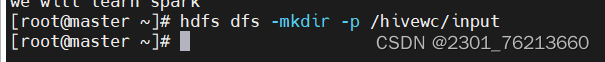

2、将文本文件上传到HDFS指定目录

- 在HDFS上创建/hivewc/input目录

hdfs dfs -mkdir -p /hivewc/input

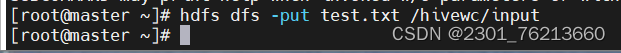

- 将test.txt文件上传到HDFS的/hivewc/input目录

(二)实现步骤

- 注意:必须要先启动Hadoop服务

执行命令:start-all.sh

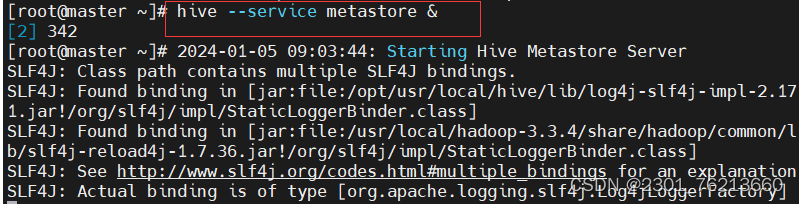

1、启动Hive Metastore服务

- 我们需要启动Hive Metastore服务,这是Hive的元数据存储服务。

- 执行命令:hive --service metastore &

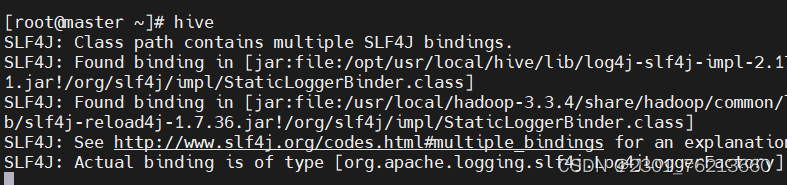

2、启动Hive客户端

- 执行命令:hive

- 一旦我们看到命令提示符hive>,就表示我们已经成功进入Hive客户端。

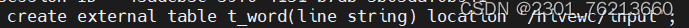

3、基于HDFS文件创建外部表

- 基于/hivewc/input下的文件创建外部表t_word,执行命令:CREATE EXTERNAL TABLE t_word(line string) LOCATION '/hivewc/input';

- 在MySQL的hive数据库的TBLS表里,我们可以查看外部表t_word对应的记录。

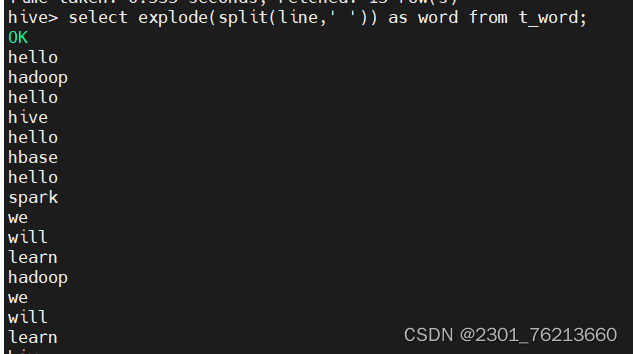

4、查询单词表,所有单词成一列

- 查看单词表记录,执行语句:SELECT line FROM t_word;

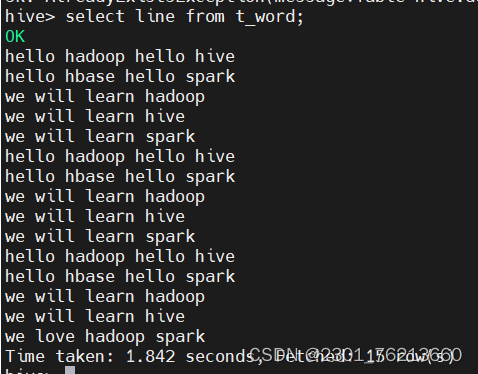

- 按空格拆分行数据,执行语句:SELECT split(line, ' ') FROM t_word;

- 让单词成一列,执行语句:SELECT explode(split(line, ' ')) AS word FROM t_word;

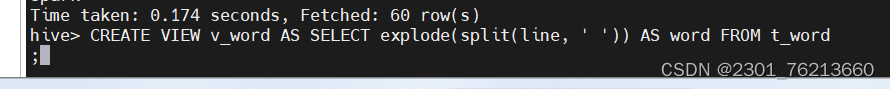

5、基于查询结果创建视图

- 基于查询结果创建了一个视图v_word,执行语句:CREATE VIEW v_word AS SELECT explode(split(line, ' ')) AS word FROM t_word;

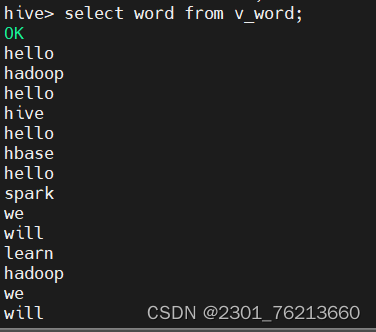

- 查询视图的全部记录,执行语句:SELECT word FROM v_word;

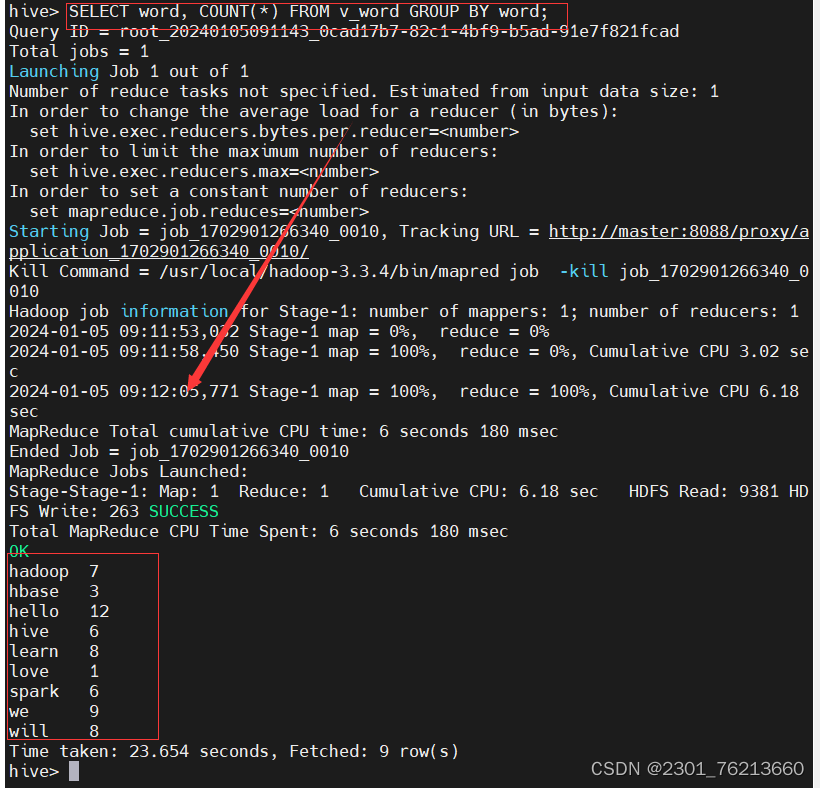

6、基于视图进行分组统计

- 基于视图分组统计操作,执行语句:SELECT word, COUNT(*) FROM v_word GROUP BY word;

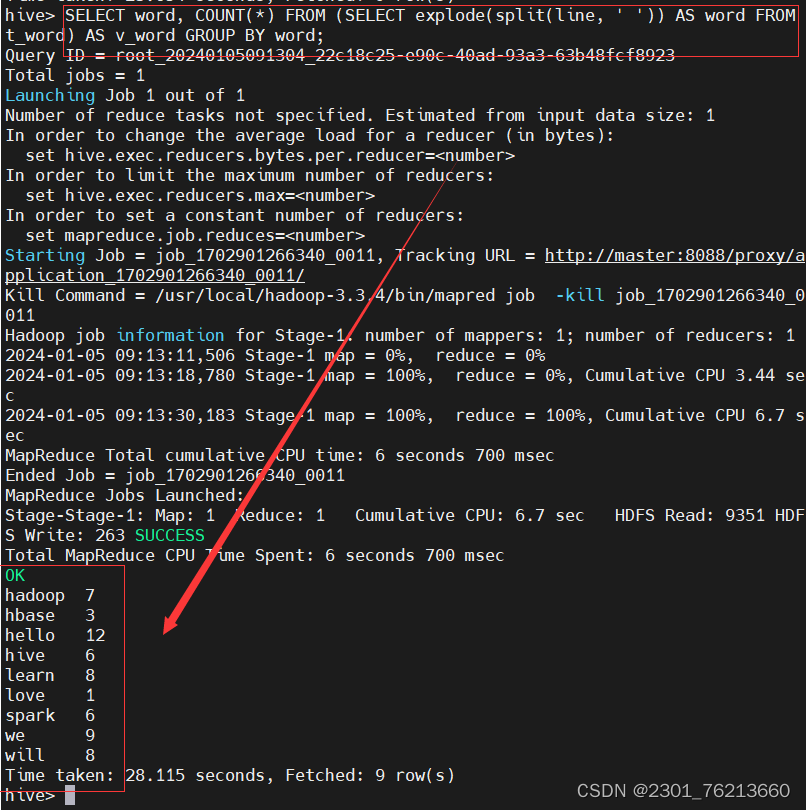

7、基于嵌套查询一步搞定

-

为了更简便地实现相同的效果,使用嵌套查询:SELECT word, COUNT(*) FROM (SELECT explode(split(line, ' ')) AS word FROM t_word) AS v_word GROUP BY word;

-

注意,这里在嵌套查询中,我们为子查询取了一个别名,这个别名是v_word。

-

这条SQL语句是在处理一个名为t_word的表,该表中有一个word字段,该字段存储的是由空格分隔的单词字符串。

1、首先,使用explode(split(line, ’ ')) AS word从t_word表中的每一行word字段创建一个新的临时表(别名v_word)。这里split(word, ’ ')函数将每个word字段的内容按照空格分割成多个单词,并生成一个多行的结果集,每行包含一个单词。

2、explode函数则将这个分割后的数组转换为多行记录,即每一行对应原字符串中的一个单词。

3、然后,通过GROUP BY word对新生成的临时表v_word中的word字段进行分组,即将所有相同的单词归为一组。

4、最后,使用COUNT(*)统计每个单词分组的数量,结果将展示每个单词及其在原始数据集中出现的次数。

5、整个查询的目的在于统计t_word表中各个单词出现的频率。

6、通过这一系列的操作,我们深入学习了Hive的外部表创建、数据加载、查询、视图创建以及统计分析的操作。希望大家能够在实际应用中灵活运用这些知识。

-

- 基于视图分组统计操作,执行语句:SELECT word, COUNT(*) FROM v_word GROUP BY word;

- 基于查询结果创建了一个视图v_word,执行语句:CREATE VIEW v_word AS SELECT explode(split(line, ' ')) AS word FROM t_word;

- 让单词成一列,执行语句:SELECT explode(split(line, ' ')) AS word FROM t_word;

- 查看单词表记录,执行语句:SELECT line FROM t_word;

- 基于/hivewc/input下的文件创建外部表t_word,执行命令:CREATE EXTERNAL TABLE t_word(line string) LOCATION '/hivewc/input';

- 执行命令:hive

- 注意:必须要先启动Hadoop服务

- 将test.txt文件上传到HDFS的/hivewc/input目录

- 在HDFS上创建/hivewc/input目录

- 在master虚拟机上创建test.txt文件

- 进行词频统计,结果如下

- 文本文件test.txt

-

猜你喜欢

- 11小时前vue-router路由模式详解

- 11小时前项目分享:基于大数据的股票数据分析系统设计与实现

- 11小时前基于 Eureka 的 Ribbon 负载均衡实现原理【SpringCloud 源码分析】

- 11小时前TDengine Kafka Connector将 Kafka 中指定 topic 的数据(批量或实时)同步到 TDengine

- 11小时前汽车座椅空调(汽车座椅空调出风口可以封掉吗)

- 8小时前跑步机维修(武汉跑步机维修)

- 8小时前小考成绩怎么查(小考成绩怎么查2024山西)

- 3小时前aabc的词语有哪些大全(aabc式的词语有什么?)

- 2小时前金盾服装(金盾服装的标志是什么)

- 1小时前xp3用什么模拟器打开(xp模拟器怎么用)

网友评论

- 搜索

- 最新文章

- 热门文章