CentOS7部署Kafka

- 一、部署

-

- 1、前置条件

- 2、下载与解压

- 3、修改配置

- 4、启动kafka

- 二、使用详解

-

- 1、创建一个主题

- 2、展示所有主题

- 3、启动消费端接收消息

- 4、生产端发送消息

- 三、代码集成

-

- pom.xml

- application.properties

- KafkaConfiguration.java

- KafkaConsumer.java

- KafkaProducer.java

- VehiclePartitioner.java

- KafkaTestController.java

一、部署

1、前置条件

1.安装jdk1.8

2.安装zookeeper

2、下载与解压

wget https://archive.apache.org/dist/kafka/2.8.0/kafka_2.12-2.8.0.tgz tar xf kafka_2.12-2.8.0.tgz

3、修改配置

cd /data/kafka_2.12-2.8.0 vim /data/kafka_2.12-2.8.0/config/server.properties

编辑内容

# broker 的编号,如果集群中有多个 broker,则每个 broker 的编号需要设置的不同 broker.id=0 # 31 行 listeners=PLAINTEXT://192.168.50.93:9092 # 123 行,修改 zookeeper.connect 为自己的 IP:PORT zookeeper.connect=localhost:2181 #存放消息日志文件的地址 log.dirs=/home/seven/kafka/kafka-logs //默认的分区数,一个topic默认3个分区数 num.partitions=2

配置详解(与部署无关)

//当前机器在集群中的唯一标识,和zookeeper的myid性质一样(broker.id和host.name每个节点都不相同) broker.id=0 //当前kafka对外提供服务的端口默认是9092listeners=PLAINTEXT://192.168.1.202:9092 //这个参数默认是关闭的,在0.8.1有个bug,DNS解析问题,失败率的问题。 host.name=hadoop1 //这个是borker进行网络处理的线程数 num.network.threads=3 //这个是borker进行I/O处理的线程数 num.io.threads=8 //发送缓冲区buffer大小,数据不是一下子就发送的,先回存储到缓冲区了到达一定的大小后在发送,能提高性能 socket.send.buffer.bytes=102400 //kafka接收缓冲区大小,当数据到达一定大小后在序列化到磁盘 socket.receive.buffer.bytes=102400 //这个参数是向kafka请求消息或者向kafka发送消息的请请求的最大数,这个值不能超过java的堆栈大小 socket.request.max.bytes=104857600 //消息存放的目录,这个目录可以配置为“,”逗号分割的表达式,上面的num.io.threads要大于这个目录的个数这个目录, //如果配置多个目录,新创建的topic他把消息持久化的地方是,当前以逗号分割的目录中,那个分区数最少就放那一个 log.dirs=/home/hadoop/log/kafka-logs //默认的分区数,一个topic默认2个分区数 num.partitions=2 //每个数据目录用来日志恢复的线程数目 num.recovery.threads.per.data.dir=1 //默认消息的最大持久化时间,168小时,7天 log.retention.hours=168 //轮转时间,当需要删除指定小时之前的数据时,该设置项很重要 log.roll.hours=12 //这个参数是:因为kafka的消息是以追加的形式落地到文件,当超过这个值的时候,kafka会新起一个文件 log.segment.bytes=1073741824 //每隔300000毫秒去检查上面配置的log失效时间 log.retention.check.interval.ms=300000 //是否启用log压缩,一般不用启用,启用的话可以提高性能 log.cleaner.enable=false //设置zookeeper的连接端口 zookeeper.connect=192.168.123.102:2181,192.168.123.103:2181,192.168.123.104:2181 //设置zookeeper的连接超时时间 zookeeper.connection.timeout.ms=6000

4、启动kafka

nohup ./kafka-server-start.sh /home/seven/kafka/config/server.properties &

二、使用详解

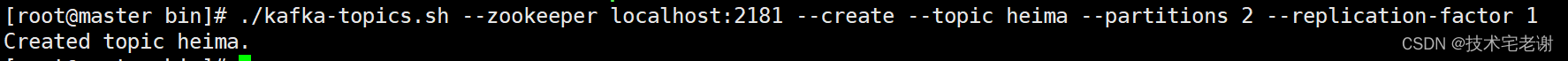

1、创建一个主题

–zookeeper:指定了kafka所连接的zookeeper服务地址

–topic:指定了所要创建主题的名称

–partitions:指定了分区个数

–replication-factor:指定了副本因子

–create:创建主题的动作指令

./kafka-topics.sh --zookeeper localhost:2181 --create --topic test --partitions 2 --replication-factor 1

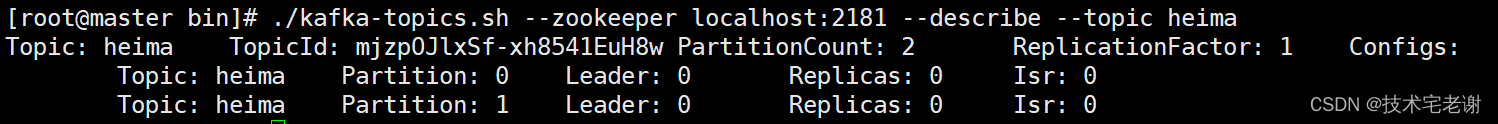

2、展示所有主题

./kafka-topics.sh --zookeeper localhost:2181 --describe --topic heartbeatMessage

3、启动消费端接收消息

–bootstrap-server 指定了连接kafka集群的地址

–topic 指定了消费端订阅的主题

./kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic heima

4、生产端发送消息

./kafka-console-producer.sh --broker-list localhost:9092 --topic heima

三、代码集成

pom.xml

org.springframework.kafka spring-kafka 2.2.0.RELEASE

application.properties

#============== kafka =================== # 指定kafka代理地址,可以多个,逗号分隔 spring.kafka.bootstrap-servers=192.168.50.93:9092 #=============== producer生产者 ======

猜你喜欢

- 3小时前大创项目推荐 深度学习火车票识别系统

- 3小时前自学(网络安全)黑客——高效学习2024

- 3小时前OpenWRT搭建个人web站点并结合内网穿透实现公网远程访问

- 3小时前Session详解,学习 Session对象一篇文章就够了

- 3小时前阿里云OSS存储图片在上传的时候设置过期时间

- 3小时前论文笔记:信息融合的门控多模态单元(GMU)

- 3小时前科技助力养老变享老,内蒙古乌兰美康养院与清雷科技达成合作

- 3小时前网络安全(黑客技术)—2024自学

- 3小时前将网页数据读入数据库+将数据库数据读出到网页——基于python flask实现网页与数据库的交互连接【全网最全】

- 46分钟前小考成绩怎么查(小考成绩怎么查2024山西)

网友评论

- 搜索

- 最新文章

- 热门文章